技术极客深度:AI权力边界失守与物理安全风险的系统性分析

回溯至北京时间昨晚,旧金山传来一则令整个科技圈震动的消息:OpenAICEO奥特曼的住宅遭遇燃烧瓶袭击。事件经过清晰:20岁嫌疑人先向住宅投掷燃烧物,随后徒步前往OpenAI总部扬言纵火,最终被警方逮捕。

时间节点:AI企业从数字威胁走向物理攻击的临界点

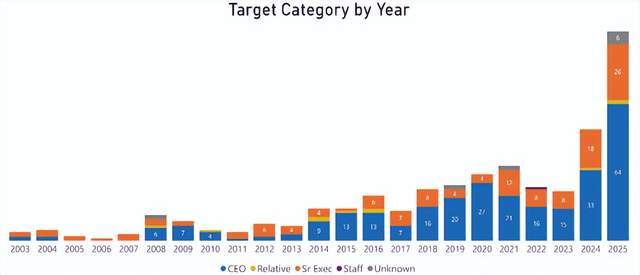

这不是孤立事件。本周早些时候,印第安纳波利斯市议员罗恩·吉布森的住所被枪手连射十三枪,门口留下“不准建数据中心”的字条。作案动机与数据中心建设审批直接相关。数据显示,2023年后针对大企业非CEO高管的绑架、侵害、尾行等人身犯罪袭击比例增幅达225%。

物理暴力攻击的频发,标志着AI引发的社会矛盾已从网络空间外溢至现实世界。这种转变不是偶然,而是技术变革与社会结构震荡的必然结果。

技术分析:AI替代焦虑的量化传导机制

审视AI替代议题时,需厘清几个关键变量:AI真实替代比例、资本方主观判断的替代意愿、行业周期导致的结构性过剩、以及企业财务优化需求。普通人难以获取完整数据,而AI巨头们在渲染替代威胁时从不提供确定性答案。

信息不对称制造焦虑,焦虑累积催生敌意,敌意寻找宣泄出口——这是暴力事件的发生逻辑链条。

方法提炼:AI治理的权能分配与风险对冲

奥特曼在公开回应中提出“全民掌管AI权能”的主张。核心逻辑:AI实验室不应独掌塑造人类未来的关键决策权。这与区块链去中心化理念形成呼应,但执行层面面临严峻挑战。

AI治理需要三个维度协同:技术层面的对齐研究、政策层面的转型托底保障、以及社会层面的认知调适。三者缺一,技术失控与社会撕裂的风险将持续攀升。

应用指导:技术从业者应对AI社会风险的操作框架

作为技术从业者,建议建立三层防护意识:个人层面警惕公开言论的煽动性传播;组织层面完善高管安保预案与危机响应机制;行业层面推动建立AI替代影响的透明评估标准。

技术本身无罪,但技术应用的权力边界需要刚性约束。当AI开始引发物理世界的暴力共振,整个行业都该重新审视:从代码安全到人心安全,这才是完整的风险图谱。